豆包大模型1.6 - 字节跳动豆包团队推出的多模态深度思考大模型

豆包大模型1.6是什么

豆包大模型1.6(Doubao-Seed-1.6)是字节跳动推出的多模态深度思考大模型。模型支持文字、图片、视频等多种输入形式,能生成高质量的文字输出。模型具备256k长上下文窗口,最大输入长度可达224k tokens,输出长度支持最大16k tokens,推理能力强。模型提供三种思考模式:auto(自动)、thinking(深度思考)和non-thinking(普通模式),支持灵活适应不同任务需求。在权威测评中,豆包1.6的推理和数学能力表现优异,广泛应用在内容创作、智能对话、代码生成、教育辅导和多模态内容生成等领域,为企业和开发者提供强大的AI生产力工具。

豆包大模型1.6模型的三个版本

- doubao-seed-1.6:全能综合型模型,模型支持256K上下文,具备深度思考、多模态理解和图形界面操作等能力。支持用户根据需求选择是否开启深度思考模式。

- doubao-seed-1.6-thinking:深度思考强化版,进一步提升代码编写、数学计算和逻辑推理等基础能力,适合需要深度分析和复杂推理的场景。

- doubao-seed-1.6-flash:极速响应版,具备深度思考和多模态理解能力,支持256K上下文,延迟极低(TOPT仅需10ms),适合对响应速度要求极高的场景,如实时交互和视觉任务处理。

豆包大模型1.6的主要功能

- 增强的推理性能:模型在推理速度、精确度和稳定性方面有显著提高,能处理更加复杂的业务场景。

- 即时搜索与深度研究:模型具备即时搜索的能力,支持根据不完全的信息进行搜索,在多轮思考和搜索后提供建议。DeepResearch功能支持迅速生成研究分析报告。

- 全面的多模态理解:模型原生支持多模态思维,能理解和处理包括文本、图像和视频在内的多种类型的数据。

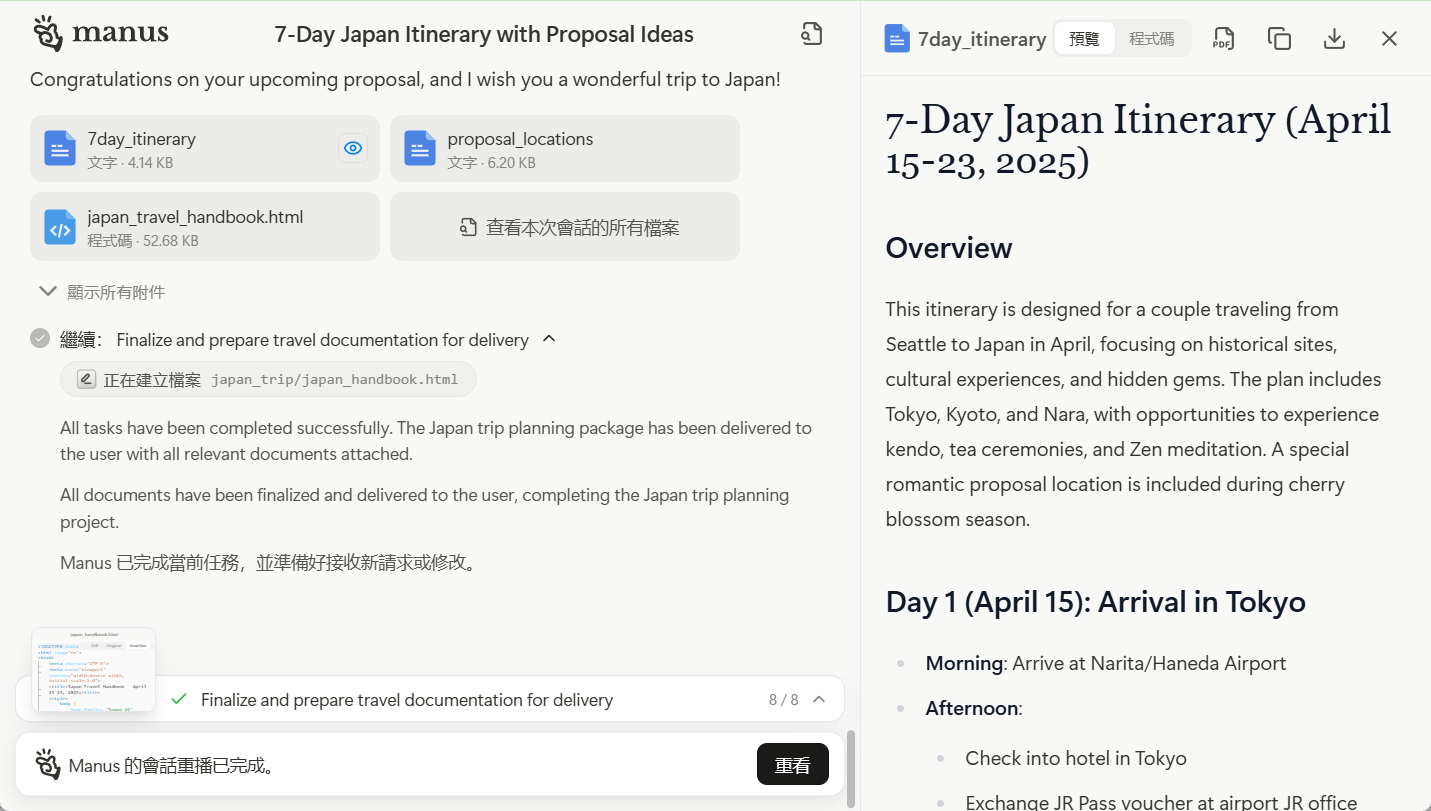

- 图形用户界面操作能力(GUI操作):基于视觉深度思考和精确定位,模型能与浏览器和其他软件进行交互,有效执行各种任务。

豆包大模型1.6的项目地址

如何使用豆包大模型1.6

- 访问官方网站:访问豆包大模型1.6的项目官网,火山引擎模型详情页。在官网上,了解更多关于模型的详细信息,包括功能、性能和应用场景。按提示完成注册和登录。

- 获取API密钥:在火山引擎控制台中,创建一个API密钥(API Key),用在后续的API调用。

- 选择模型版本:根据需求选择豆包大模型1.6的不同版本。

- 编写代码调用API:用Python或其他编程语言编写代码,调用豆包大模型1.6的API。

import requests

import json

# API密钥和接口地址

api_key = "your_api_key"

api_secret = "your_api_secret"

model_version = "doubao-seed-1.6" # 或doubao-seed-1.6-thinking、doubao-seed-1.6-flash

api_url = f"https://api.volcengine.com/v1/model/{model_version}"

# 请求数据

data = {

"input": "你的输入文本",

"parameters": {

"max_length": 256, # 输出的最大长度

"temperature": 0.7, # 随机性参数

"top_p": 0.9, # 核心采样参数

"top_k": 50, # 核心采样参数

"do_sample": True # 是否采样

}

}

# 设置请求头

headers = {

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

}

# 发送请求

response = requests.post(api_url, headers=headers, data=json.dumps(data))

# 处理响应

if response.status_code == 200:

result = response.json()

print("模型输出:", result["output"])

else:

print("请求失败,状态码:", response.status_code)

print("错误信息:", response.text)豆包大模型1.6的性能表现

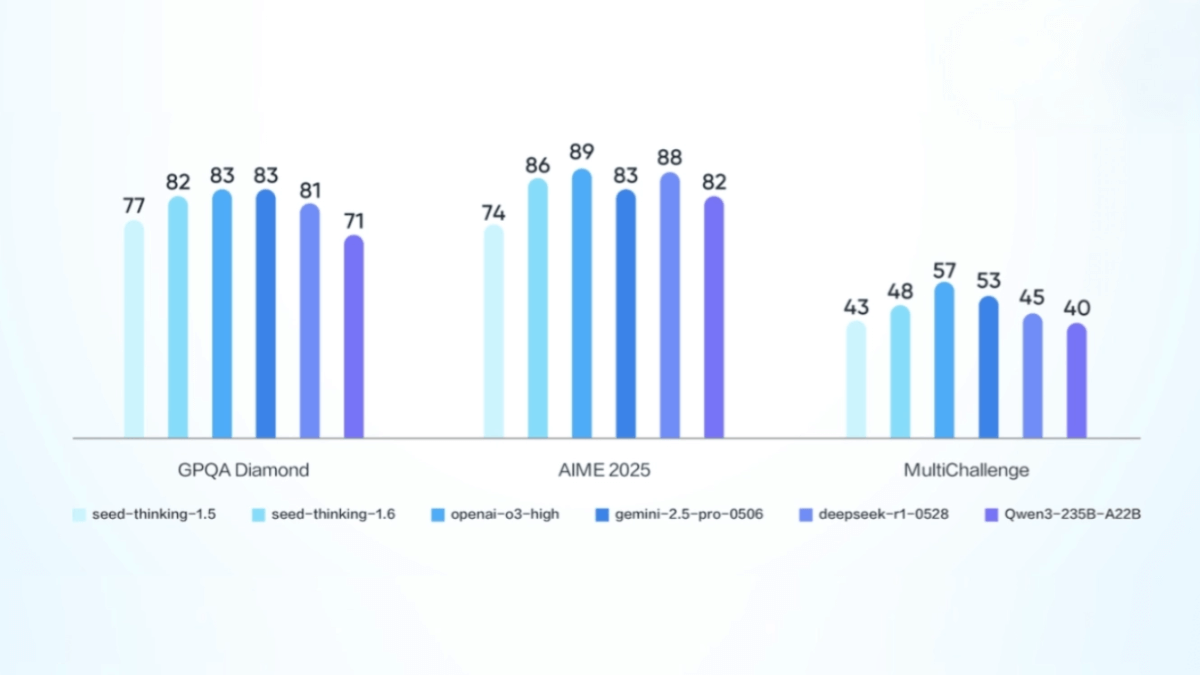

- GPQA Diamond测试:豆包1.6-thinking模型在GPQA Diamond测试中取得了81.5分的成绩。这一成绩达到全球第一梯队水平,成为目前最好的推理模型之一。

- math测评AIME25:豆包1.6-thinking模型在数学测评AIME25中的成绩达到86.3分。相比之前的豆包1.5深度思考模型,成绩提升12.3分,显示出显著的进步。

豆包大模型1.6的定价模式

豆包大模型1.6的定价基于统一的模式,tokens的计价均一致。

- 输入长度0-32K:

- 输入价格:0.8元/百万tokens。

- 输出价格:8元/百万tokens。

- 输入长度32K-128K:

- 输入价格:1.2元/百万tokens。

- 输出价格:16元/百万tokens。

- 输入长度128K-256K:

- 输入价格:2.4元/百万tokens。

- 输出价格:24元/百万tokens。

- 输入32K、输出200 tokens以内:

- 输入价格:0.8元/百万tokens。

- 输出价格:2元/百万tokens。

豆包大模型1.6的核心优势

- 多模态处理能力:处理和理解多种类型的数据输入,包括文本、图片和视频,这使得它在多媒体内容生成和理解方面具有显著优势。

- 三种思考模式:提供auto(自动)、thinking(深度思考)和non-thinking(普通模式)三种模式,适应不同的任务需求和复杂度。

- 长上下文窗口:支持高达256k的长上下文窗口,最大输入长度可达224k tokens,输出长度支持最大16k tokens,适合处理复杂的长文本任务。

- 强大的推理能力:在多个权威测评中表现优异,特别是在推理和数学能力方面,能快速进行逻辑推理和问题解决。

- 高效的批量处理和缓存优化:支持批量处理和缓存优化,能高效处理大规模数据,适合高并发场景。

- 广泛的应用场景:适用内容创作、智能对话、代码生成、教育辅导和多模态内容生成等多个领域,为企业和开发者提供了强大的AI生产力工具。

豆包大模型1.6的适用人群

- 内容创作者:作家、编辑、记者、自媒体运营者等,生成高质量的广告文案、新闻报道、故事、小说等。

- 开发者和程序员:用豆包大模型1.6辅助生成代码片段,提高开发效率,或者用于排查代码中的错误。

- 教育工作者和学生:教师生成教学资源,辅助备课;学生用在解答学科问题,辅助学习和研究。

- 企业决策者和分析师:用豆包大模型1.6的推理和分析能力,进行市场分析、风险评估等,支持决策制定。

- 智能客服和聊天机器人开发者:用豆包大模型1.6提供自然流畅的多轮对话体验,提升用户交互效率。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...