HealthGPT: un gran modelo médico de apoyo al análisis de imágenes médicas y a las preguntas y respuestas diagnósticas

Introducción general

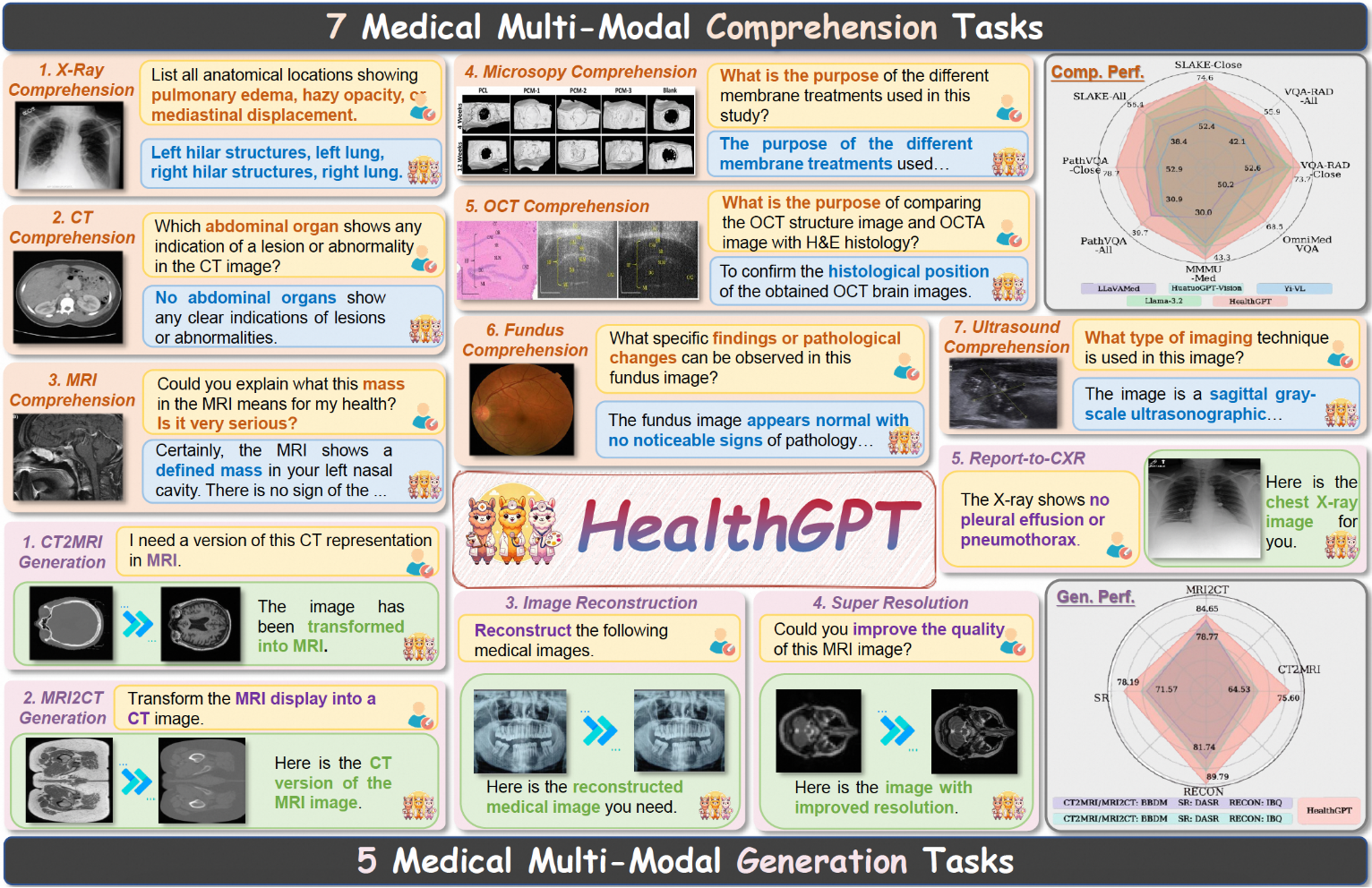

HealthGPT es un modelo de gran lenguaje visual médico de última generación que pretende lograr capacidades unificadas de comprensión y generación visual médica mediante la adaptación de conocimientos heterogéneos. El objetivo del proyecto es integrar la comprensión visual médica y las capacidades de generación en un marco autorregresivo unificado, lo que mejora significativamente la eficiencia y la precisión del procesamiento de imágenes médicas.HealthGPT soporta una amplia gama de tareas de comprensión médica y tareas de generación, y es capaz de funcionar bien en varios escenarios de procesamiento de imágenes médicas. El proyecto ha sido desarrollado conjuntamente por la Universidad de Zhejiang, la Universidad de Ciencia y Tecnología Electrónica, Alibaba, la Universidad de Ciencia y Tecnología de Hong Kong, la Universidad Nacional de Singapur y muchas otras organizaciones, y tiene un gran valor práctico y de investigación.

Lista de funciones

- Preguntas y respuestas médicas visuales: admite una amplia gama de imágenes médicas para tareas de preguntas y respuestas, respondiendo con precisión a las preguntas médicas planteadas por los usuarios.

- Generación de imágenes médicas: capaz de generar imágenes médicas de alta calidad para ayudar en el diagnóstico y la investigación médica.

- Soporte de clasificación de tareas: admite 7 tipos de tareas de comprensión médica y 5 tipos de tareas de generación médica, que cubren una amplia gama de escenarios de aplicación médica.

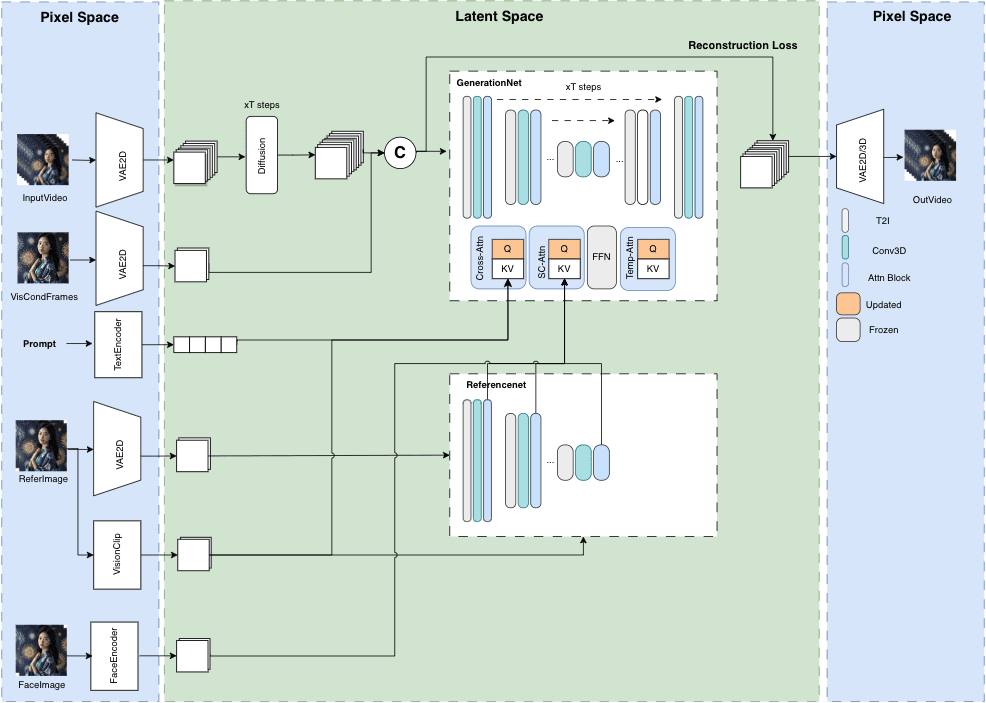

- Arquitectura del modelo: el contenido textual y visual se genera utilizando la percepción visual jerárquica y los plugins H-LoRA, seleccionando características visuales y plugins H-LoRA.

- Modelo multiversión: se proporcionan las configuraciones HealthGPT-M3 y HealthGPT-L14 para adaptarse a diferentes necesidades y recursos respectivamente.

Utilizar la ayuda

Proceso de instalación

- Preparar el entorno

En primer lugar, clona el proyecto y crea un entorno de ejecución Python:git clone https://github.com/DCDmllm/HealthGPT.git cd HealthGPT conda create -n HealthGPT python=3.10 conda activate HealthGPT pip install -r requirements.txt

- Preparar las pesas de preentrenamiento

Uso de HealthGPTclip-vit-large-patch14-336Como codificadores visuales, HealthGPT-M3 y HealthGPT-L14 se basan, respectivamente, enPhi-3-mini-4k-instructresponder cantandophi-4Formación previa.

Descargue los pesos de modelo necesarios y colóquelos en el directorio correspondiente:- Modelización ViT:enlace de descarga

- HealthGPT-M3 modelo base:enlace de descarga

- HealthGPT-L14 modelo base:enlace de descarga

- Modelo VQGAN:enlace de descarga

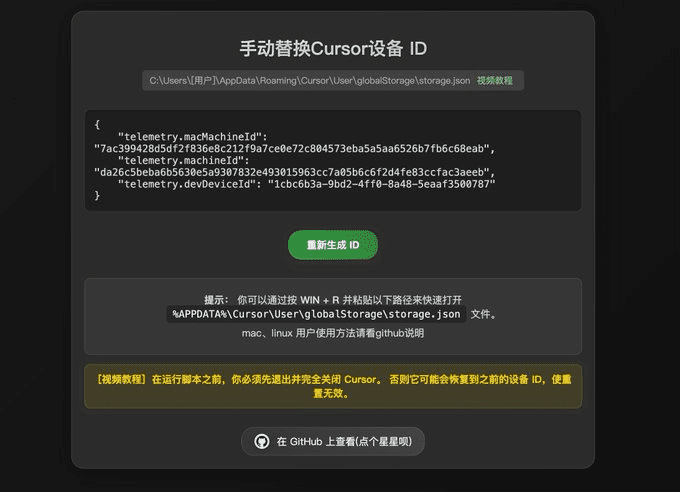

- Preparación de H-LoRA y pesas adaptadoras

Descargue y coloque los pesos H-LoRA para mejorar la comprensión visual médica y las capacidades de generación del modelo. Los pesos completos se publicarán en breve, así que permanezca atento.

inferencia

Preguntas y respuestas sobre la visión médica

- Descargar los documentos necesarios

- Actualizar ruta de script

espectáculo (una entrada)llava/demo/com_infer.shcambie la siguiente variable por la ruta del archivo descargado:- MODEL_NAME_OR_PATH: Ruta o identificador del modelo base

- VIT_PATH: Ruta de peso del modelo de transformador visual

- HLORA_PATH: Comprensión visual de las rutas de peso H-LoRA

- FUSION_LAYER_PATH: Ruta de peso de la capa de fusión

- Ejecución de scripts

cd llava/demo bash com_infer.shTambién es posible ejecutar directamente comandos de Python:

python3 com_infer.py \ --model_name_or_path "microsoft/Phi-3-mini-4k-instruct" \ --dtype "FP16" \ --hlora_r "64" \ --hlora_alpha "128" \ --hlora_nums "4" \ --vq_idx_nums "8192" \ --instruct_template "phi3_instruct" \ --vit_path "openai/clip-vit-large-patch14-336/" \ --hlora_path "path/to/your/local/com_hlora_weights.bin" \ --fusion_layer_path "path/to/your/local/fusion_layer_weights.bin" \ --question "Your question" \ --img_path "path/to/image.jpg"

Reconstrucción de imágenes

comandante en jefe (militar)HLORA_PATHajustado agen_hlora_weights.biny configurar otras rutas de modelos:

cd llava/demo

bash gen_infer.sh

También puede ejecutar directamente el siguiente comando de Python:

python3 gen_infer.py \

--model_name_or_path "microsoft/Phi-3-mini-4k-instruct" \

--dtype "FP16" \

--hlora_r "256" \

--hlora_alpha "512" \

--hlora_nums "4" \

--vq_idx_nums "8192" \

--instruct_template "phi3_instruct" \

--vit_path "openai/clip-vit-large-patch14-336/" \

--hlora_path "path/to/your/local/gen_hlora_weights.bin" \

--fusion_layer_path "path/to/your/local/fusion_layer_weights.bin" \

--question "Reconstruct the image." \

--img_path "path/to/image.jpg" \

--save_path "path/to/save.jpg"© declaración de copyright

El artículo está protegido por derechos de autor y no debe reproducirse sin autorización.

Artículos relacionados

Sin comentarios...