OpenManus : la version open source de Manus par MetaGPT

Introduction générale

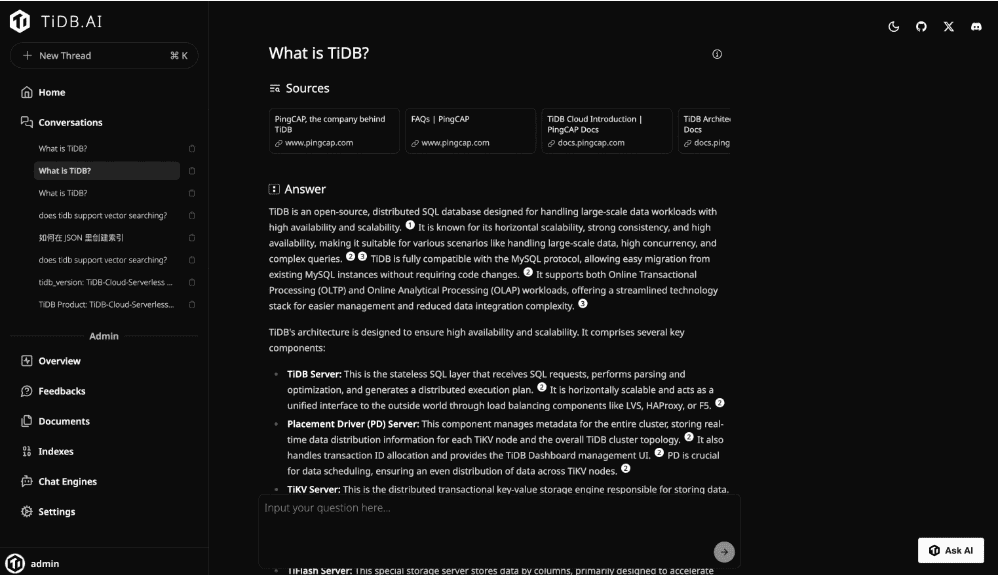

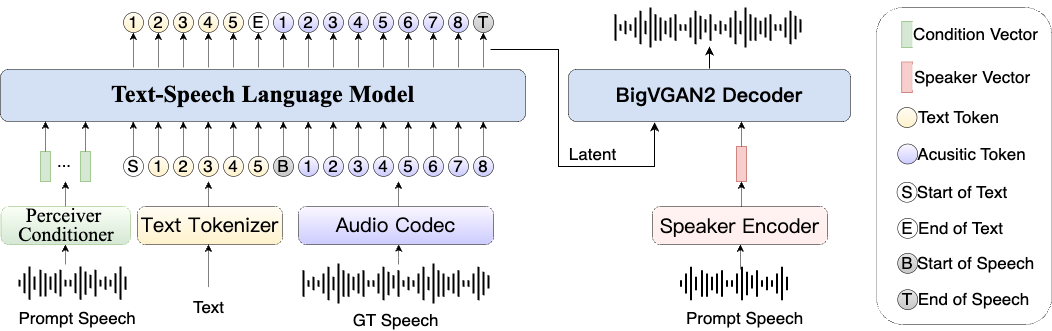

OpenManus est un projet open source conçu pour aider les utilisateurs à faire fonctionner des intelligences localement avec des configurations simples pour réaliser diverses idées créatives. Il se compose de MetaGPT Les membres de la communauté @mannaandpoem, @XiangJinyu, @MoshiQAQ et @didiforgithub l'ont développé en seulement 3 heures. En attendant, vous pouvez suivre leur projet de programmation automatisée ! MGX Comparé à Manus, qui nécessite un code d'invitation, OpenManus ne nécessite aucune barrière à l'entrée. Par rapport à Manus, qui nécessite un code d'invitation, OpenManus ne requiert aucune barrière à l'entrée, et les utilisateurs n'ont qu'à cloner le code et à configurer l'API LLM pour démarrer rapidement. Le projet est basé sur le développement Python, avec une structure simple et claire, prenant en charge l'entrée de tâches par le terminal pour conduire le corps intelligent à effectuer des opérations. Il s'agit actuellement d'une implémentation rudimentaire, et l'équipe est ouverte aux suggestions ou aux contributions au code. Les plans futurs incluent l'optimisation de la planification des tâches et l'ajout de capacités de démonstration en temps réel.

Version de l'interface OpenManus : https://github.com/YunQiAI/OpenManusWeb

OpenManusWeb (non officiel)

Liste des fonctions

- Opération de l'intelligentsia localeExécuter des opérations automatisées localement à l'aide de l'API LLM configurée en entrant des tâches par l'intermédiaire du terminal.

- Prise en charge des modèles LLM courantsLe modèle GPT-4o est intégré par défaut, et l'utilisateur peut ajuster la configuration du modèle selon ses besoins.

- démarrage par touche unique: Run

python main.pyVous pouvez accéder rapidement au mode de saisie des tâches. - Version expérimentale: Fourni

python run_flow.pyUtilisé pour tester les nouvelles fonctionnalités en cours de développement. - Collaboration communautaireLes membres de l'équipe peuvent participer au développement du projet en soumettant des problèmes ou du code via GitHub.

Utiliser l'aide

Processus d'installation

L'installation d'OpenManus est simple et convient aux utilisateurs familiers avec Python. Voici les étapes détaillées :

1. créer l'environnement Conda

Pour éviter les conflits de dépendances, il est recommandé de créer un environnement autonome à l'aide de Conda :

conda create -n open_manus python=3.12

conda activate open_manus

- instructionsLa première commande crée un fichier nommé

open_manusen utilisant Python 3.12 ; la deuxième commande active l'environnement et l'invite du terminal devient(open_manus). - conditions préalablesConda doit être installé et peut être téléchargé à partir du site web d'Anaconda.

2. cloner le dépôt de code

Téléchargez le projet OpenManus sur GitHub :

git clone https://github.com/mannaandpoem/OpenManus.git

cd OpenManus

- instructionsLa première commande clone le code localement et la seconde entre dans le répertoire du projet.

- conditions préalablesGit : Git doit être installé, ce qui peut être fait via

git --versionVérifiez s'il est disponible, sinon téléchargez-le à partir de git-scm.com.

3. installation des dépendances

Installez les paquets Python nécessaires à votre projet :

pip install -r requirements.txt

- instructions: :

requirements.txtrépertorie tous les paquets dépendants qui seront automatiquement installés lors de l'exécution de cette commande. - optimisation du réseauSi le téléchargement est lent, vous pouvez utiliser un miroir domestique tel que

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple.

Étapes de la configuration

OpenManus nécessite que l'API LLM soit configurée pour piloter la fonctionnalité smartbody, comme décrit ci-dessous :

1. création de fichiers de configuration

Dans le répertoire racine du projet de l'application config pour créer un fichier de configuration :

cp config/config.example.toml config/config.toml

- instructionsCette commande permet de copier le fichier d'exemple en tant que fichier de configuration réel.

config.tomlest le fichier lu au moment de l'exécution.

2. éditer les fichiers de configuration

spectacle (un billet) config/config.tomlRemplissez votre clé API et vos paramètres :

# 全局 LLM 配置

[llm]

model = "gpt-4o"

base_url = "https://api.openai.com/v1"

api_key = "sk-..." # 替换为你的 OpenAI API 密钥

max_tokens = 4096

temperature = 0.0

# 可选的视觉模型配置

[llm.vision]

model = "gpt-4o"

base_url = "https://api.openai.com/v1"

api_key = "sk-..." # 替换为你的 OpenAI API 密钥

- Description des paramètres: :

model: Spécifie le modèle LLM, la valeur par défaut est GPT-4o.base_urladresse d'accès à l'API, par défaut l'interface officielle d'OpenAI.api_keyClé : Clé obtenue de l'OpenAI pour l'authentification.max_tokensNombre maximal d'appareils de génération unique jeton qui contrôle la longueur de la sortie.temperature: Contrôle le caractère aléatoire du contenu généré, 0,0 indiquant le résultat le plus stable.

- Obtenir la clé APIPour ce faire, vous devez vous rendre sur le site web d'OpenAI, vous connecter et générer une clé sur la page "API Keys", puis la copier dans votre fichier de configuration.

Fonctionnement et utilisation

Une fois l'installation et la configuration terminées, OpenManus peut être démarré de la manière suivante :

1. opérations de base

Exécuter le programme principal :

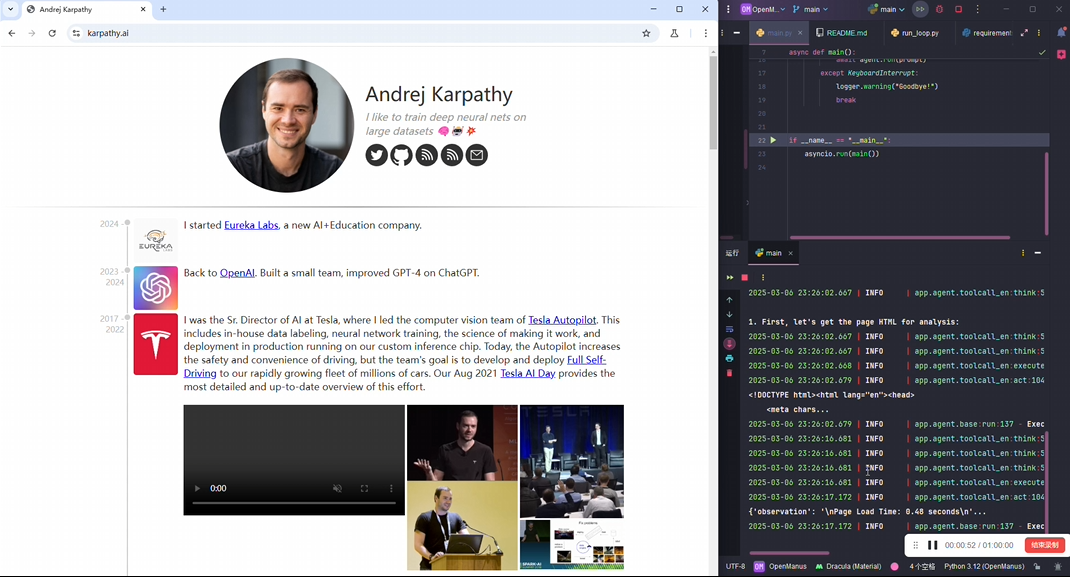

python main.py

- flux de travail: :

- Une fois que le terminal a affiché l'invite, entrez votre tâche (par exemple, "Aidez-moi à générer un plan hebdomadaire").

- Appuyez sur Entrée pour valider et OpenManus appelle LLM pour traiter la tâche.

- Les résultats du traitement sont affichés directement sur le terminal.

- Scénarios d'utilisationLe logiciel est idéal pour effectuer des tests rapides ou des tâches simples telles que la génération de texte ou d'extraits de code.

2. les cycles expérimentaux

Exécutez la version instable pour découvrir les nouvelles fonctionnalités :

python run_flow.py

- spécificités: Inclut des fonctionnalités en cours de développement, peut présenter des bogues, et convient aux utilisateurs qui veulent l'essayer.

- prendre noteLe fichier de configuration doit être correct, sinon l'exécution risque d'échouer.

Fonction en vedette Fonctionnement

Opération de l'intelligentsia locale

- Description fonctionnelleLe système de gestion des tâches est un système de gestion des tâches qui consiste à entrer une tâche via le terminal et OpenManus appelle LLM localement pour la traiter et renvoyer le résultat.

- Exemple de fonctionnement: :

- être en mouvement

python main.py. - Entrée : "Écrire une fonction Python qui calcule la somme de 1 à 100".

- Exemple de sortie :

def sum_to_100(): return sum(range(1, 101))

- être en mouvement

- tranchantIl fonctionne localement sans téléchargement de données, protège la vie privée et est réactif.

Prise en charge des modèles LLM courants

- Description fonctionnelleLes utilisateurs peuvent passer d'un modèle de LLM à l'autre en fonction de leurs besoins.

- procédure: :

- compilateur

config.tomlvolontémodelPasser à un autre modèle (par exemple"gpt-3.5-turbo"). - Sauvegarder et exécuter

python main.py. - Tâches d'entrée pour expérimenter les résultats de différents modèles.

- compilateur

- suggestionLe GPT-4o pour les tâches complexes et le GPT-3.5-turbo pour les tâches simples sont plus rentables.

Problèmes courants résolus...

- questionsLe programme s'exécute avec l'erreur "ModuleNotFoundError".

- régler (un litige)Vérifier que les dépendances sont entièrement installées et réexécuter la procédure.

pip install -r requirements.txt.

- régler (un litige)Vérifier que les dépendances sont entièrement installées et réexécuter la procédure.

- questions: "Invalid API key".

- régler (un litige): Inspection

config.tomla fait moucheapi_keyest correcte, ou régénérer la clé.

- régler (un litige): Inspection

- questionsLes courses sont bégayées ou ne répondent pas.

- régler (un litige)Vérifiez que la connexion au réseau est stable, ou réduisez le nombre d'utilisateurs.

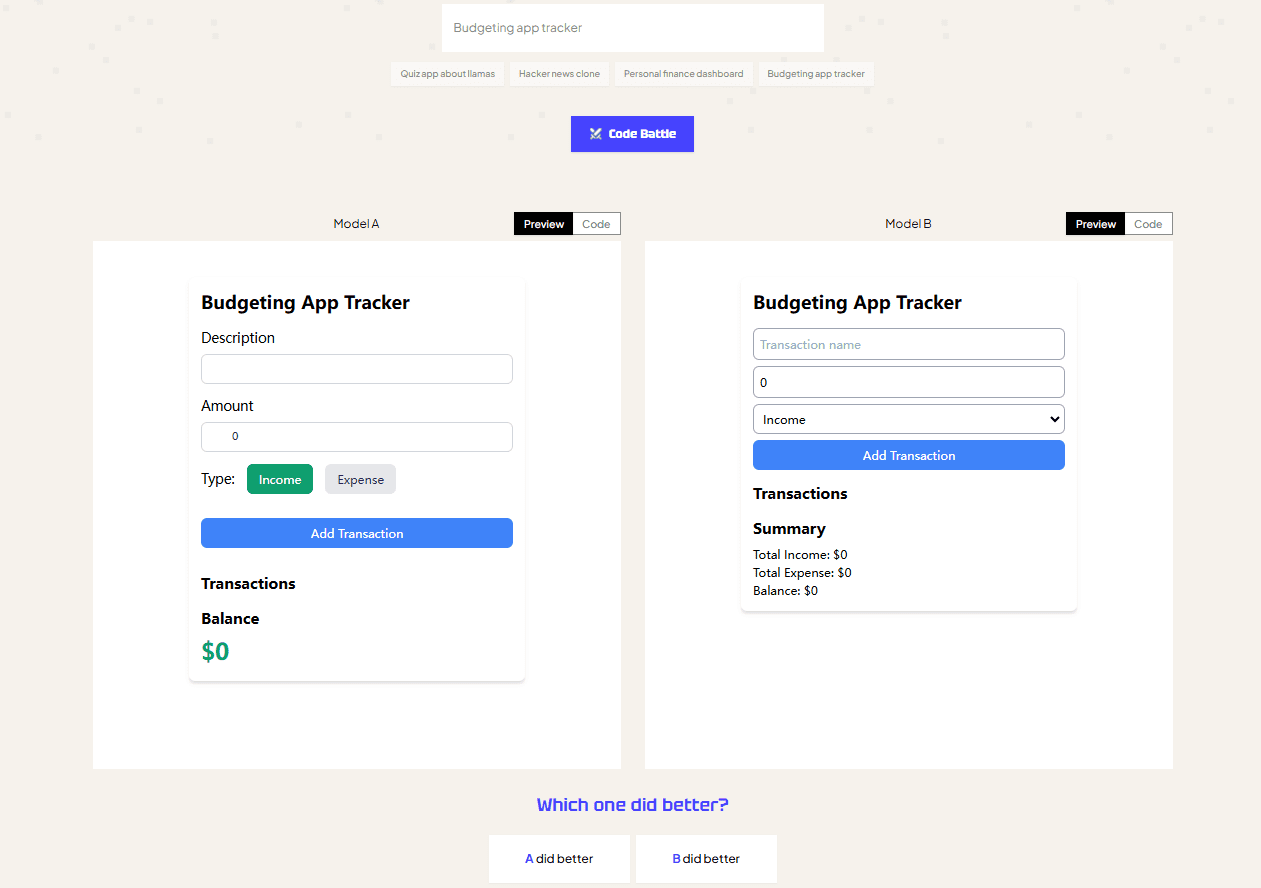

max_tokensafin de réduire le nombre de calculs. - Voir la démoLes projets fournissent Vidéo de démonstrationLes résultats d'exploitation réels ne sont pas nécessairement le reflet des résultats d'exploitation réels.

- régler (un litige)Vérifiez que la connexion au réseau est stable, ou réduisez le nombre d'utilisateurs.

© déclaration de droits d'auteur

L'article est protégé par le droit d'auteur et ne doit pas être reproduit sans autorisation.

Articles connexes

Pas de commentaires...