HunyuanVideo-Avatarとは?

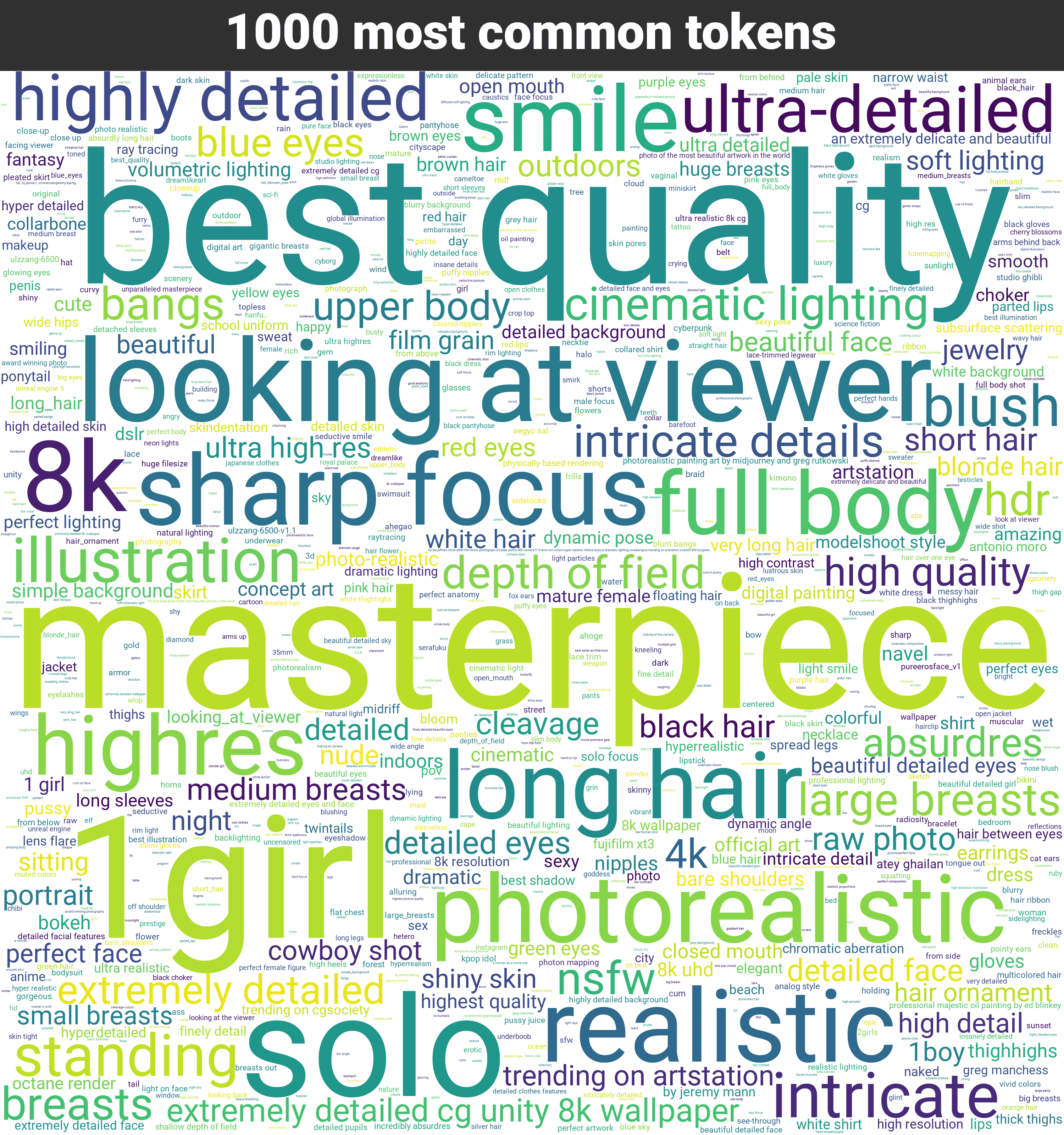

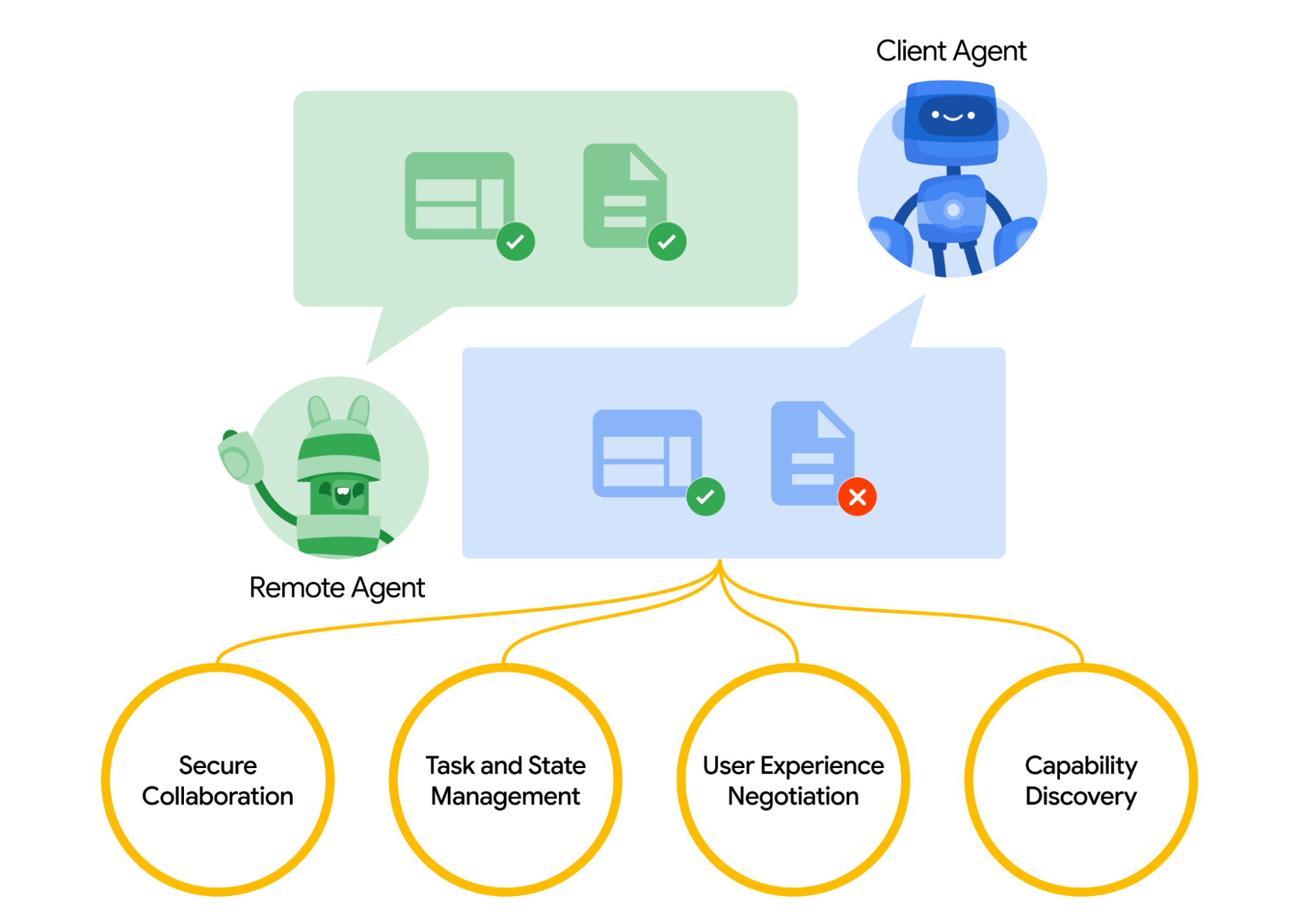

HunyuanVideo-Avatarは、テンセントのHunyuanチームとTencent Music Tianqin Labが共同で発表した先進的な音声対応デジタル人体モデルです。革新的なマルチモーダル拡散トランスフォーマーアーキテクチャに基づき、このモデルはユーザーがアップロードしたキャラクター画像と音声に基づいて、自然な表情、リップシンク、全身の動きを持つダイナミックな動画を生成する。HunyuanVideo-Avatarは、サイバーパンク、2Dアニメ、中国の水墨画など、幅広いスタイルと種族をサポートし、さまざまな分野のクリエイティビティのニーズに応えます。

HunyuanVideo-Avatarの主な機能

- ビデオ・ジェネレーションユーザーがキャラクターの画像と音声をアップロードすると、モデルが自動的に音声の感情と環境を分析し、自然な表情、リップシンク、全身の動きのビデオを生成する。

- マルチロール・インタラクション多人数参加型のインタラクティブなシナリオで複数のキャラクターを正確に操作し、唇や表情、動きと音声を完璧にシンクロさせます。

- マルチスタイル対応サイバーパンク、2Dアニメ、中国水墨画など、さまざまなスタイルをサポートし、さまざまな創作ニーズに応える。

HunyuanVideo-Avatar公式サイトアドレス

- プロジェクトのウェブサイト::https://hunyuanvideo-avatar.github.io/

- Githubリポジトリ::https://github.com/Tencent-Hunyuan/HunyuanVideo-Avatar

- HuggingFaceモデルライブラリ::https://huggingface.co/tencent/HunyuanVideo-Avatar

- arXivテクニカルペーパー::https://arxiv.org/pdf/2505.20156

HunyuanVideo-Avatarの使い方

- リソースへのアクセスアクセスGitHubリポジトリコードを取得するかHuggingFaceモデルライブラリ訓練済みモデルを直接ロードする。

- 依存関係のインストールリポジトリをクローンし、依存関係をインストールする。

git clone https://github.com/Tencent-Hunyuan/HunyuanVideo-Avatar.git

cd HunyuanVideo-Avatar

pip install -r requirements.txt- データ入力の準備キャラクターの画像と、それに対応する音声ファイルを用意する。

- ビデオの作成生成スクリプトを実行する:

python generate_video.py --image_path <人物图像路径> --audio_path <音频文件路径> --output_path <输出视频路径>- 調整パラメーターエモーショナルなスタイルやキャラクターとのやり取りなど、必要に応じてパラメータを調整してください。

HunyuanVideo-Avatarの主な利点

- マルチモーダルフュージョン画像、音声、テキストの同時処理をサポートし、高品質なモーションビデオを作成します。

- 役割の一貫性生成された映像の登場人物の動きや表情が自然で一貫性があること。

- 感情スタイルのコントロール感情参照画像に基づく映像の感情スタイル制御

- マルチロール・インタラクション各キャラクターのアクションや表情が独立したマルチキャラクターシーンに対応。

- 効率的なトレーニングと推論時空間圧縮技術に基づく学習と推論プロセスの高速化。

- マルチスタイル対応様々な創作ニーズに応えるため、様々なスタイルやシーンに対応。

- 高画質ビデオ自然なリップシンクロと動きで、自然で滑らかなビデオを生成します。

HunyuanVideo-Avatarを利用する人々

- コンテンツクリエーター高品質なビデオを素早く作成し、クリエイティブの効率を高めます。

- 企業のマーケティング担当者ブランドを高めるための広告やマーケティングビデオを制作。

- 教育者ビデオ形式で知識を提示することで、教育と学習を強化する。

- ゲーム開発者リアルなゲームシーンとキャラクターアニメーションを生成します。

- eコマース・プラクティショナーセールスコンバージョンを高めるための製品デモンストレーションビデオを制作。

© 著作権表示

この記事は著作権で保護されており、許可なく複製することは禁じられている。

関連記事

コメントはありません