AppAgent: 멀티모달 인텔리전스를 사용한 자동화된 스마트폰 작동

일반 소개

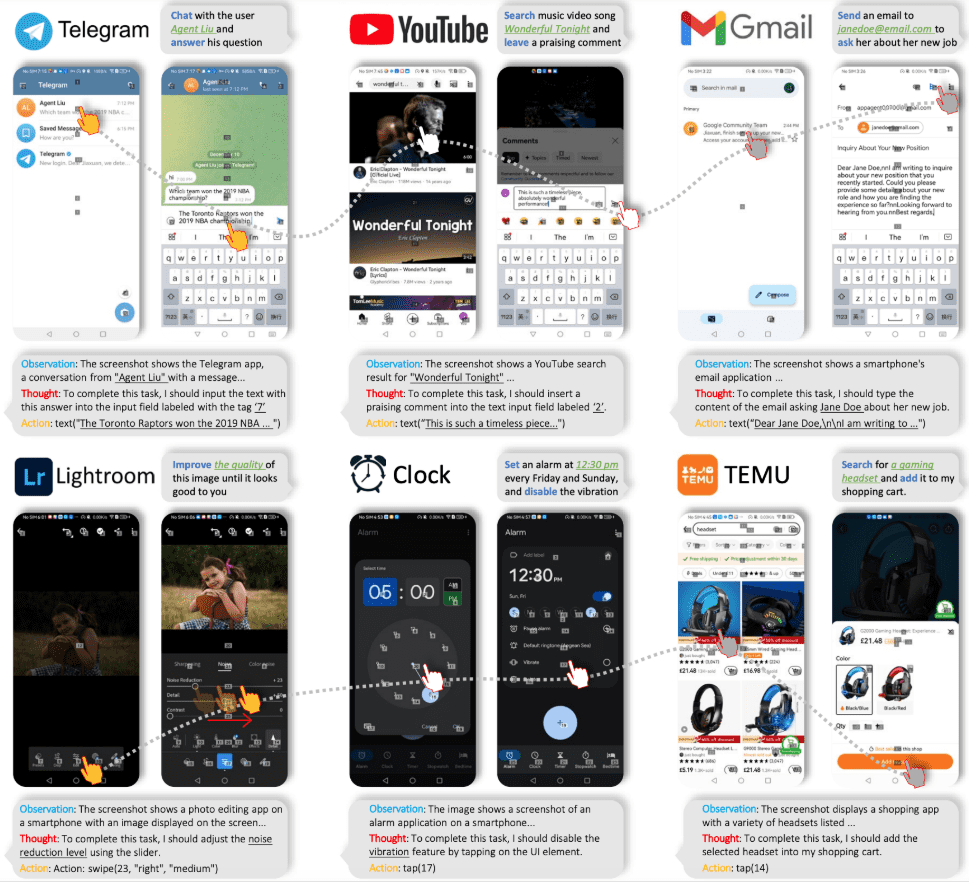

앱에이전트는 스마트폰 애플리케이션을 작동하도록 설계된 LLM(대규모 언어 모델) 기반의 멀티모달 에이전트 프레임워크입니다. 이 프레임워크는 탭과 스와이프와 같은 인간의 상호 작용을 모방하는 단순화된 조작 공간을 통해 다양한 애플리케이션에 걸쳐 적용 가능성을 확장하므로 시스템 백엔드 액세스가 필요하지 않으며, 앱에이전트는 사람의 시연을 자율적으로 탐색하거나 관찰하여 새로운 애플리케이션 사용법을 학습하고 복잡한 작업을 수행할 수 있는 지식 기반을 생성합니다.

텐센트는 현재 휴대폰 인터페이스와 사용자 명령을 인식하여 실제 사용자처럼 휴대폰을 직접 조작할 수 있는 멀티모달 지능형 바디 앱에이전트를 출시했습니다! 예를 들어, 사진 편집 소프트웨어를 작동하여 사진을 편집하고, 지도 애플리케이션을 열어 내비게이션을 실행하고, 쇼핑을 하는 등의 작업을 수행할 수 있습니다.

프로젝트 홈페이지: https://appagent-official.github.io

논문 링크: https://arxiv.org/abs/2312.13771

논문 초록

최근 대규모 언어 모델(LLM)의 발전으로 복잡한 작업을 수행할 수 있는 지능형 스마트 바디가 만들어졌습니다. 이 백서에서는 스마트폰 애플리케이션을 조작하기 위해 설계된 대규모 언어 모델 기반의 지능형 바디를 위한 새로운 멀티모달 프레임워크를 소개합니다. 이 프레임워크를 사용하면 지능형 신체가 단순화된 조작 공간을 통해 마치 사람이 클릭 및 스와이프 작업을 수행하는 것과 같은 방식으로 스마트폰 앱을 조작할 수 있습니다. 이 혁신적인 접근 방식은 시스템의 백엔드에 직접 액세스할 필요가 없으므로 다양한 애플리케이션에 적합합니다. 인텔리전스 기능의 핵심은 학습에 대한 혁신적인 접근 방식에 있습니다. 인텔리전스는 스스로 탐색하거나 사람의 시연을 관찰함으로써 새로운 애플리케이션을 탐색하고 사용하는 방법을 학습합니다. 이 과정에서 다양한 애플리케이션에서 복잡한 작업을 수행하기 위해 의존하는 지식 기반을 구축합니다. 인텔리전스의 유용성을 입증하기 위해 소셜 미디어, 이메일, 지도, 쇼핑, 복잡한 이미지 편집 도구 등 10가지 애플리케이션의 50가지 작업에 대해 철저한 테스트를 거쳤습니다. 테스트 결과는 광범위한 고급 작업을 효율적으로 처리할 수 있는 인텔리전스의 능력을 입증합니다.

기능 목록

- 자기 주도적 탐색상담원은 자율적으로 애플리케이션을 탐색하고, 대화형 요소를 기록하고, 문서를 생성할 수 있습니다.

- 인간 데모 학습에이전트는 사람의 시연을 관찰하여 작업을 학습하고 적절한 문서를 생성합니다.

- 위임 구현배포 단계에서 에이전트는 생성된 문서를 기반으로 복잡한 작업을 수행합니다.

- 멀티 모달 입력텍스트 입력과 시각적 입력을 모두 지원하며, GPT-4V 또는 Qwen-VL-Max 모델을 사용합니다.

- 캡차 처리: 캡챠로 인증할 수 있습니다.

- UI 요소 인식그리드 오버레이를 사용하여 태그가 지정되지 않은 UI 요소를 배치합니다.

도움말 사용

설치 및 구성

- 다운로드 및 설치GitHub 페이지에서 프로젝트 파일을 다운로드하고 필요한 종속 요소를 설치합니다.

- 구성 파일루트 디렉터리의

config.yaml파일을 사용하여 GPT-4V 또는 Qwen-VL-Max 모델에 대한 API 키를 구성할 수 있습니다. - 연결된 장치USB를 사용하여 Android 기기를 연결하고 개발자 옵션에서 USB 디버깅을 활성화합니다.

자체 탐색 모델

- 탐색 시작: 실행

learn.py파일을 열고 자율 탐색 모드를 선택한 다음 애플리케이션 이름과 작업 설명을 입력합니다. - 상호 작용 기록에이전트가 자동으로 애플리케이션을 탐색하고 상호 작용 요소를 기록하며 문서를 생성합니다.

인간 데모 모드

- 스타트업 데모: 실행

learn.py파일을 열고 휴먼 데모 모드를 선택한 다음 애플리케이션 이름과 작업 설명을 입력합니다. - 이그제큐티브 데모메시지에 따라 상담원이 모든 상호작용을 기록하고 문서를 생성합니다.

위임 구현

- 작업 시작: 실행

run.py파일을 열고 애플리케이션 이름과 작업 설명을 입력한 다음 적절한 문서 라이브러리를 선택합니다. - 운영상담원이 문서에 따라 복잡한 작업을 완료하는 작업을 수행합니다.

세부 운영 절차

- 프로젝트 다운로드GitHub 페이지로 이동하여 프로젝트 파일을 다운로드하고 압축을 풉니다.

- 종속성 설치터미널에서 실행

pip install -r requirements.txt모든 종속성을 설치합니다. - 구성 모델필요에 따라 수정

config.yaml파일을 사용하여 GPT-4V 또는 Qwen-VL-Max 모델에 대한 API 키를 구성할 수 있습니다. - 연결된 장치USB를 사용하여 Android 장치를 연결하고 장치에서 USB 디버그 모드를 활성화합니다.

- 탐색 또는 데모 시작하기: 실행

learn.py파일을 열고 자율 탐색 또는 인간 데모 모드를 선택한 다음 애플리케이션 이름과 작업 설명을 입력합니다. - 문서 생성상담원이 모든 상호작용을 기록하고 후속 작업 실행을 위한 문서를 생성합니다.

- 운영: 실행

run.py문서를 클릭하고 애플리케이션 이름과 작업 설명을 입력한 후 적절한 문서 라이브러리를 선택하면 에이전트가 해당 문서를 기반으로 작업을 수행합니다.

© 저작권 정책

이 글은 저작권이 있으며 무단으로 복제해서는 안 됩니다.

관련 문서

댓글 없음...