Dify에서 제공하는 API를 OpenAI 인터페이스와 호환되는 형식으로 변환하려면 어떻게 해야 하나요?

네, 그랬죠. Dify Dify를 아시는 분들은 아시겠지만, 훌륭한 AI 앱이지만 제공하는 API가 Open AI와 호환되지 않아 일부 앱에서 Dify와 연동할 수 없다는 점을 알고 계실 겁니다.

이에 대해 어떻게 할 수 있나요?

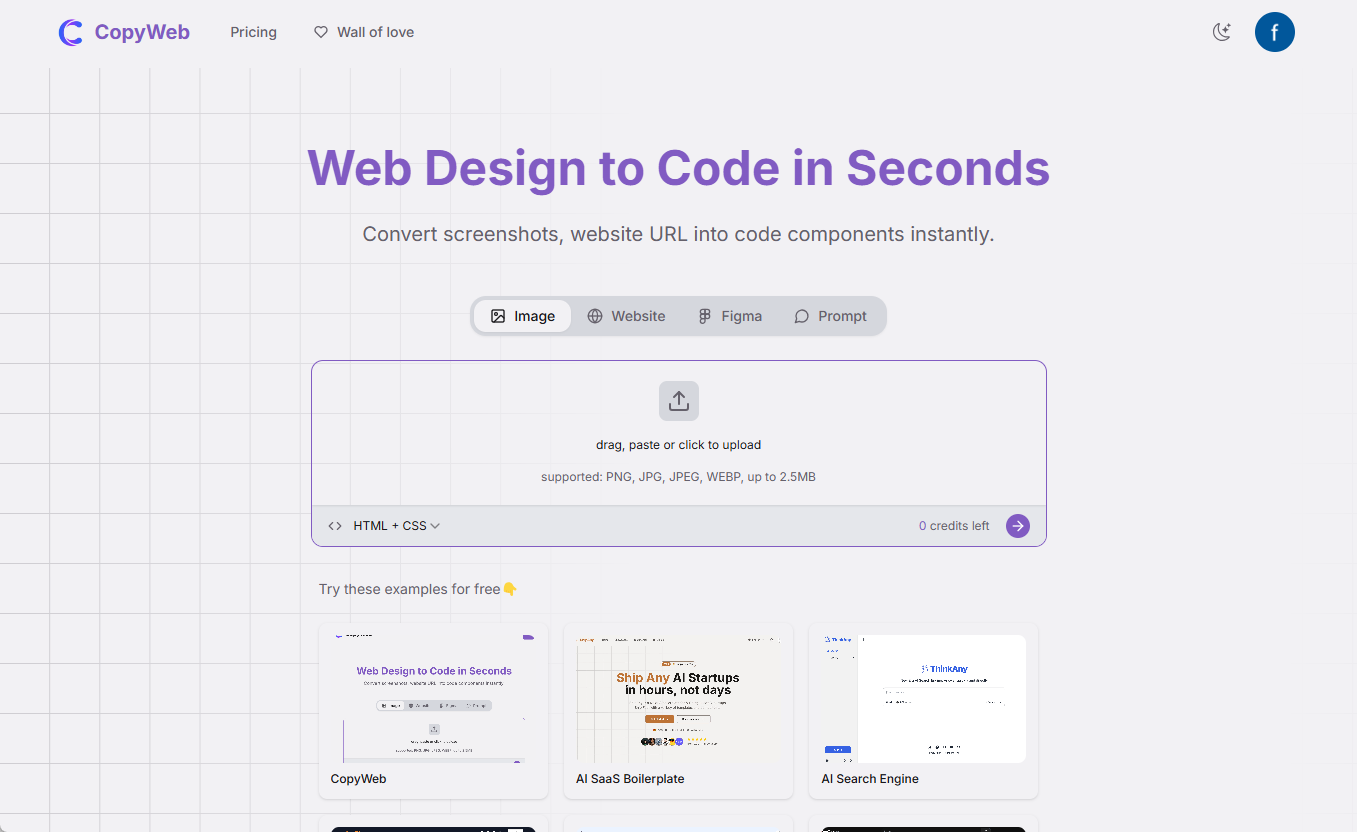

"트랜짓 API"를 사용할 수 있으며, 가장 유명한 것은 다음과 같습니다. 하나의 API: 다중 모델 API 관리 및 로드 밸런싱, 배포 시스템 서로 다른 AI 모델을 한데 모아 OpenAI API로 통합하여 배포할 수는 있지만, 아직 Dify의 액세스를 지원하지 않기 때문에 방법이 있긴 하지만 위의 문제를 해결할 수는 없습니다.

현재 두 번째 오픈을 위해 One API를 기반으로 한 큰 샷, 프로젝트 이름은 다음과 같습니다. 새로운 API이 프로젝트는 Dify를 완벽하게 지원하므로 드디어 Dify API를 사용할 수 있게 되었습니다!

배포가 성공적으로 완료되면 IP + 포트를 통해 액세스합니다:

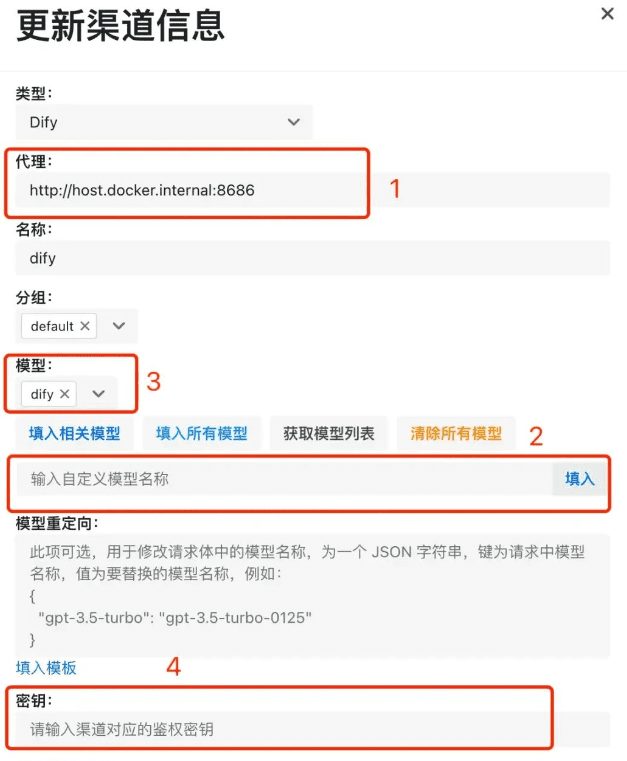

- 디파이 유형을 확인한 후에는 디파이 서비스의 주소를 입력해야 합니다. 새 API 서비스와 Dify가 모두 도커를 통해 단일 머신에 배포되는 경우, 새 API 서비스의 주소를 입력하는 것을 잊지 마세요.

http://host.docker.internal:你的端口号스크린샷은 제가 만든 예시이므로 그대로 복사하지 마세요. 도커 배포 방법을 사용하지 않는 경우, 디파이 서비스의http:// ip + 端口号준비 완료; - dify에 액세스하고 있으므로 모델 선택을 위해 사용자 정의 모델 이름(예: dify)을 입력한 다음 마지막에 '채우기' 버튼을 클릭하기만 하면 됩니다;

- 사용자 지정 모델이든 선택한 다른 모델이든 스크린샷의 3번 위치에 표시되어야 하며, 표시되지 않으면 구성되지 않은 것입니다;

- 제출이 완료되면 채널 목록에서 데이터를 확인할 수 있습니다 ~~.

© 저작권 정책

이 글은 저작권이 있으며 무단으로 복제해서는 안 됩니다.

관련 문서

댓글 없음...