TANGO: 디지털 인물의 전신 제스처를 음성으로 생성하는 초상화 동영상 도구

일반 소개

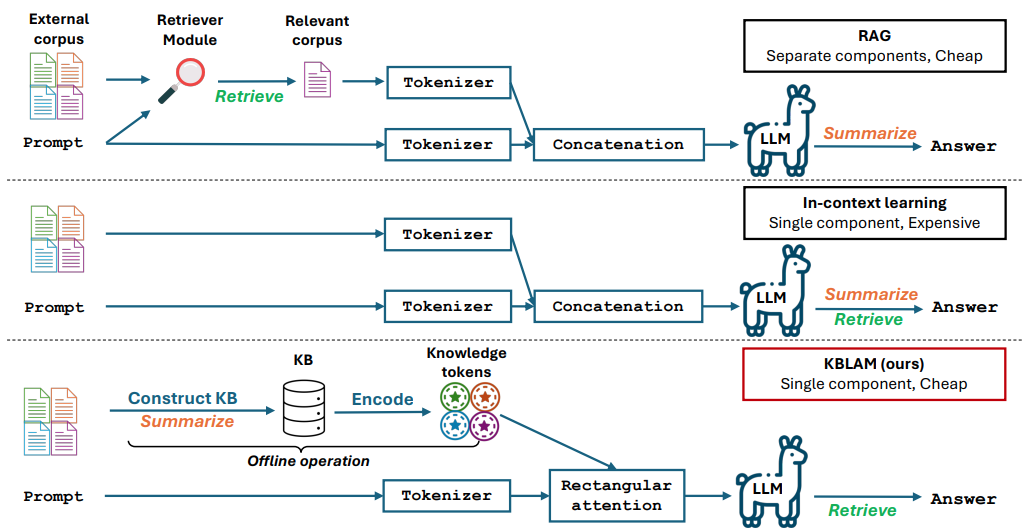

TANGO(계층적 오디오-모션 임베딩 및 확산 보간을 사용한 공동 음성 제스처 비디오 재현)는 도쿄대학교와 CyberAgent AI Labs가 공동 개발한 오픈 소스입니다. 이 공동 개발한 오픈소스 프레임워크로, 협업 음성 제스처 비디오 생성을 위한 프레임워크입니다. 이 프로젝트는 계층적 오디오-모션 임베딩 공간과 확산 보간을 사용하여 입력 음성을 기반으로 자연스럽고 매끄럽고 동기화된 캐릭터 제스처 비디오를 자동으로 생성하며, TANGO는 암시적으로 계층적인 오디오-모션 임베딩 공간에서 대상 음성과 가장 일치하는 참조 비디오 클립을 먼저 검색한 다음 동작 보간에 확산 모델을 사용하는 혁신적인 동작 그래프 검색 방법을 통해 고품질의 제스처-액션 생성을 달성합니다. 액션 생성. 이 프로젝트는 AI 기반 인간-컴퓨터 상호작용에 대한 연구를 발전시킬 뿐만 아니라 가상 앵커 및 디지털 휴먼과 같은 애플리케이션에 중요한 기술 지원을 제공합니다.

현재 오픈 소스 TANGO는 최대 8초 오디오만 지원하므로 사용하기 전에 오디오 파일을 세그먼트화해야 합니다!

완벽한 디지털 인물 프로젝트를 위해 음성 립싱크 도구를 사용하여 작업하세요: 동기화 ,Wav2Lip 초경량 디지털 휴먼. 전체 워크플로: 대위법을 위한 초경량 디지털 휴먼, 신체 움직임을 생성하는 탱고, 얼굴을 바꾸는 페이스퓨전, 완벽합니다!

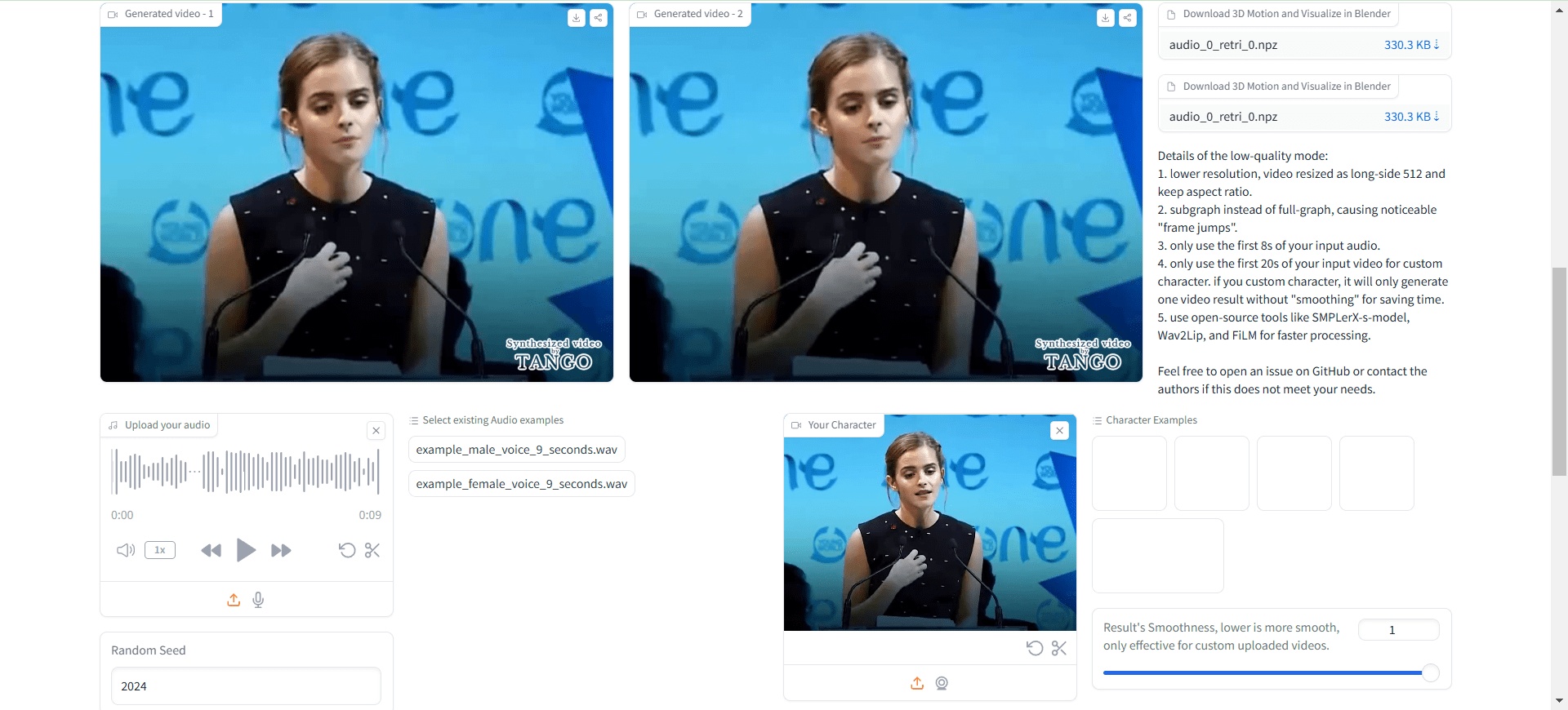

온라인 체험: https://huggingface.co/spaces/H-Liu1997/TANGO

기능 목록

- 매우 정확한 제스처 동기화: 모든 오디오를 비디오의 제스처와 정확하게 동기화합니다.

- 다국어 지원: CGI 얼굴과 합성 사운드를 포함한 다양한 언어와 사운드로 작업할 수 있습니다.

- 오픈 소스 및 무료: 코드는 완전히 공개되며 사용자는 자유롭게 사용하고 수정할 수 있습니다.

- 대화형 데모: 사용자가 비디오 및 오디오 파일을 업로드하여 체험할 수 있는 온라인 데모를 제공합니다.

- 사전 교육 모델: 다양한 사전 교육 모델을 제공하여 사용자가 직접 사용하거나 2차 교육을 받을 수 있습니다.

- 전체 교육 코드: 제스처 동기화 판별기 및 TANGO 모델에 대한 교육 코드가 포함되어 있습니다.

도움말 사용

1. 환경 설정

1.1 기본 요구 사항:

- Python 버전: 3.9.20

- CUDA 버전: 11.8

- 디스크 공간: 최소 35GB(모델 및 미리 계산된 다이어그램 저장용)

1.2 설치 단계:

# 克隆项目仓库

git clone https://github.com/CyberAgentAILab/TANGO.git

cd TANGO

git clone https://github.com/justinjohn0306/Wav2Lip.git

git clone https://github.com/dajes/frame-interpolation-pytorch.git

# 创建虚拟环境(可选)

conda create -n tango python==3.9.20

conda activate tango

# 安装依赖

pip install -r ./pre-requirements.txt

pip install -r ./requirements.txt

2. 사용 흐름

2.1 빠른 시작:

- 추론 스크립트를 실행합니다:

python app.py

처음 실행하면 시스템이 필요한 체크포인트 파일과 미리 계산된 다이어그램을 자동으로 다운로드합니다. 약 8초 분량의 동영상을 생성하는 데는 약 3분 정도의 처리 시간이 소요됩니다.

2.2 사용자 지정 역할 만들기:

- 새 캐릭터의 액션 피규어를 만들어야 하는 경우:

python create_graph.py

무엇보다도 이 프로젝트는 기본적으로 아래와 유사한 TANGO 워터마크가 포함된 동영상을 생성합니다:

기본적으로 원본 동영상과 워터마크가 있는 이미지를 새로운 동영상으로 합성하는 로컬 ffmpeg를 호출하는 것입니다.

워터마크를 원하지 않는 경우 다음과 같이 변경할 수 있습니다.app.py가운데:

gr.Video(value="./datasets/cached_audio/demo1.mp4", label="Demo 0", , watermark="./datasets/watermark.png") # 修改为 gr.Video(value="./datasets/cached_audio/demo1.mp4", label="Demo 0")

로컬 호스트가 아닌 액세스, 수정이 필요합니다:

demo.launch(server_name="0.0.0.0", server_port=7860)

로드된 동영상에서 워터마크를 찾지 못하면 다시 엽니다.

결과 동영상에는 오디오가 없으므로 수동으로 오디오를 합성해야 합니다.

/usr/bin/ffmpeg -i outputs/gradio/test_0/xxx.mp4 -i gen_audio.wav -c:v libx264 -c:a aac result_wav.mp4

몸의 움직임에는 아무런 문제가 없으며 입 모양이 완전히 잘못되었다는 것을 알 수 있습니다.

그렇지 않습니다. 초경량 디지털 휴먼 유용하게 사용하셨나요?

사용 프로세스

- 로컬 서버에 액세스: 브라우저에서 열기

http://localhost:3000. - 비디오 및 오디오 업로드: 입력 상자에 동기화하려는 오디오 및 비디오 파일을 업로드합니다.

- 제스처 동기화 수행 : "동기화" 버튼을 누르면 시스템이 자동으로 제스처 동기화 프로세스를 수행합니다.

- 결과 보기 및 다운로드: 동기화가 완료되면 결과를 미리 보고 동기화된 동영상 파일을 다운로드할 수 있습니다.

- 인터랙티브 데모 사용: 데모 페이지에서 비디오 및 오디오 파일을 업로드하여 제스처 동기화 효과를 실시간으로 체험할 수 있습니다.

- 프로젝트 관리: 내 프로젝트 페이지에서 업로드된 모든 프로젝트를 확인하고 관리하며, 버전 관리 및 공동 작업을 지원합니다.

고급 기능

- 지능형 제스처 동기화: AI가 제공하는 지능형 제스처 동기화를 통해 동영상 콘텐츠의 프레젠테이션을 개선합니다.

- 다국어 지원: 프로젝트의 필요에 따라 다양한 언어와 음성을 선택할 수 있습니다.

- 사용자 지정 개발: TANGO는 오픈 소스이므로 사용자는 필요에 따라 개발할 수 있습니다.

© 저작권 정책

이 글은 저작권이 있으며 무단으로 복제해서는 안 됩니다.

관련 문서

댓글 없음...